クリエイターであれば、コンテンツを少しでも目立たせたいと考えるものですよね。しかし、どんなに魅力的な画像でも、静止画のままだと物足りなく感じてしまうことはありませんか?

もし、その画像を動かせたらどうでしょう。動きを加えることで、ストーリーに楽しさや感情が生まれます。それを手軽に実現できるのが、Wan 画像から動画生成(Wan 動画生成)ツールです。

本記事では、このツールにフォーカスし、仕組みや主な特徴、使い方について詳しく解説します。さらに、画像から動画をより簡単に作成できる便利な代替ツールについてもご紹介します。

Part 1: Wan 画像から動画生成とは?

Wanは、Alibaba(アリババ)の通義実験室(Tongyi Lab)が開発したオープンソースのAI動画生成モデル群です。Wan 2.xシリーズでは、「画像から動画生成(Image-to-Video/I2V)」が主要な機能の一つとして提供されています。静止画像を最初のフレームとして入力し、必要に応じてテキストプロンプトを加えることで、そのシーンをアニメーション化した短い動画を生成します。

公式APIの説明でも、「画像を最初のフレームとして使用し、プロンプトに基づいて動画を生成する」と明記されています。

Wan 2.1(2024)および後継モデルのWan 2.2(2024)のいずれも、画像から動画生成タスクに対応しています。Wan 2.1には2つのモデルサイズがあり、処理速度を重視した1.3Bパラメータの「Turbo」と、高品質な生成を可能にする14Bの「Plus」が用意されています。さらにWan 2.2では、最大1080pの高解像度出力に対応するなど、画質や表現力が向上しています。

Wan 画像から動画生成の主な特徴

Wan 動画生成における主な特徴は以下の通りです。

画像から動画へのアニメーション生成:

静止画像をダイナミックな動画クリップへ変換します。水の流れ、空の動き、揺れるオブジェクト、人物のアクションなど、自然なモーションを追加できます。

テキスト+画像による制御:

入力画像に加えてテキストプロンプトを指定することで、アニメーションの方向性を細かくコントロールできます。シーンの雰囲気やオブジェクトの動き、ストーリー性の演出に役立ちます。

高品質な動画出力:

Wan 2.2では最大1080pの解像度に対応。滑らかでシネマティックな映像表現と、リアルな動きを実現します。

柔軟な動画の長さ:

モデルサイズに応じて、約3〜12秒の短い動画クリップを生成します。高性能な14Bモデルでは、1.3Bの軽量モデルよりも長く、高解像度な動画生成が可能です。

多言語テキスト表現:

英語や中国語のテキストを判読可能な形で動画内に生成できる点も特徴です。キャプション、看板、ブランド表現などに活用できます。

オープンソースで高い汎用性:

Apache 2.0ライセンスのもとで完全にオープンソースとして提供されています。小型モデルであれば、8〜9GB程度のVRAMを持つ一般的なGPU環境でもローカル実行が可能です。

開発者フレンドリーな統合環境:

Hugging Face Diffusers、ComfyUI、各種API(Alibaba ModelScope、Fal.ai など)に対応。すぐに試せる推論用スクリプトやノートブックも用意されています。

複数のモデルバリエーション:

- Turbo(1.3B): 高速・軽量で、比較的スペックの低い環境向けに最適化されています。

- Plus(14B): より高精細な表現が可能で、長尺かつ質感豊かな動画生成に対応します。

Wan 2.1 と Wan 2.2 の違いとは?

以下は、Wan 2.1 と Wan 2.2 の画像から動画生成モデルを比較した表です。それぞれの主な違いを把握するのに役立ちます。

| 機能 | Wan 2.1 | Wan 2.2 |

|---|---|---|

| モデルバリエーション | Turbo(1.3B)、Plus(14B) | 大規模モデルを改良(処理効率を向上) |

| 最大解像度 | 最大720p | 最大1080p(フルHD) |

| 動画の長さ | 約3〜5秒(Turbo)、最大約12秒(Plus) | 長さはほぼ同等だが、画質がより鮮明 |

| 画像から動画生成 | 対応 | 対応(リアリティと動きが向上) |

| テキストから動画生成 | 対応 | 対応(歪みが少なく、結果がより安定) |

| テキスト描画 | 英語・中国語の文字を判読可能な形で表示 | テキスト描画の精度と安定性が向上 |

| パフォーマンス | 1.3Bは約8〜9GBのVRAMで動作、14Bはより高いスペックが必要 | 生成速度と滑らかさを最適化 |

| オープンソース | Apache 2.0 ライセンス | Apache 2.0 ライセンス |

Wan 2.2では、Wan 2.1の画像から動画生成機能をベースに、1080pフルHD出力への対応、よりシャープな映像表現、滑らかなモーション、アーティファクトの低減などが実現されています。動画内のテキストもよりクリアかつ安定し、生成処理の効率も向上しました。つまり、Wan 2.2はWan 2.1の主要機能を洗練させ、画質とパフォーマンスの両面を強化したモデルと言えます。

Wan 動画生成の最新動向(概要)

近年のWan 動画生成モデルでは、画像から動画生成における画質や安定性が着実に向上しています。従来と比べて、人物や背景の動きはより自然になり、映像全体の一貫性も改善されてきました。

ただし、こうした高品質な結果を得るためには、モデル選択やプロンプトの調整、各種設定の理解が重要となり、生成には一定の試行錯誤が必要な場合もあります。

そのため、Wanは研究や検証用途、細かな制御を重視するユーザーには適している一方で、操作の簡単さや作業効率を重視する一般的なコンテンツ制作では、ややハードルが高いと感じられることもあります。

Wan 画像から動画生成の使い方

以下は、Wan 画像から動画生成ツールの基本的な使い方です。

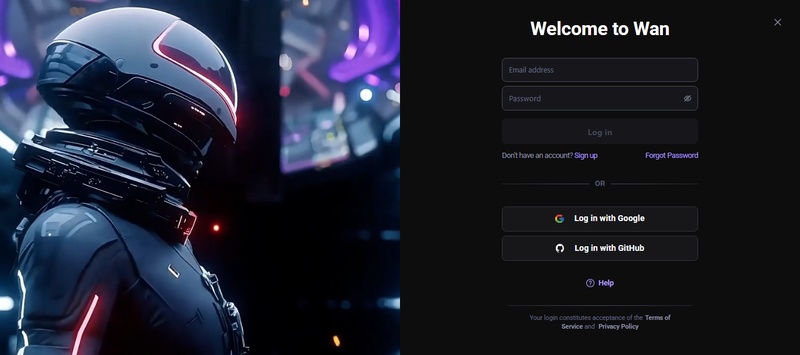

Step 1: Wanの公式サイト にアクセスし、アカウントでログインします。初めての場合は、新規アカウントを作成してください。

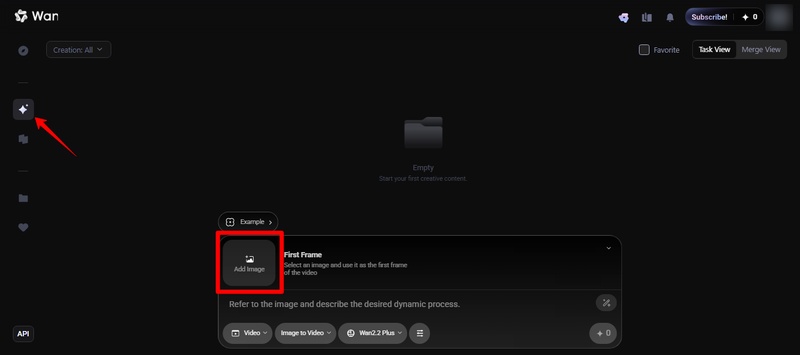

Step 2: ログイン後、左側のメニューから 「Generate」 をクリックします。表示された画面で 「Add Image」 ボタンを選択し、動画の最初のフレームとして使用する画像をアップロードします。

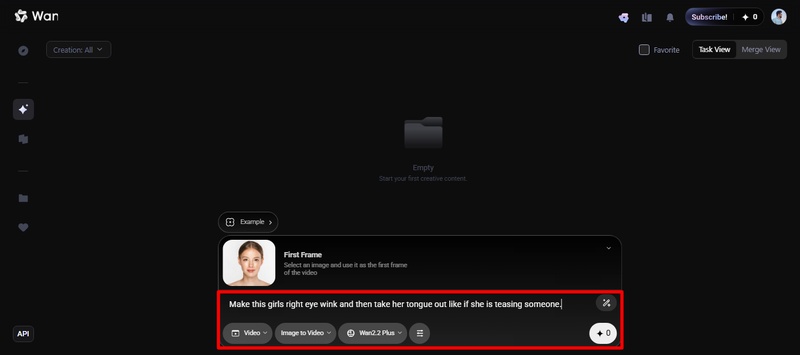

Step 3: 画像をアップロードしたら、任意のプロンプトを入力します。画像から動画生成モデルが選択されていることを確認し、 Generate ボタンをクリックしてください。Wan 動画生成ツールが、静止画像をもとに動きのある動画の生成を開始します。

Wan 画像から動画生成に関するユーザーの評価

WanはオープンソースのAI動画生成モデルでありながら、映像のリアリティや質感の高さが評価されています。 特に高精度モデルを使用した場合、背景表現や全体の雰囲気が自然であるという声が多く見られます( 出典 )。

一方で、フレーム間の一貫性については課題も指摘されています。 人物を含む画像では、顔や細部の特徴が途中で変化してしまうケースがあり、安定性にはばらつきがあるようです。

また、低解像度で生成した場合には、アーティファクトや不自然なフレームが発生することもあります。 そのため、一定以上の解像度や適切な設定が求められます。

総合的に見ると、Wanは高品質な動画生成が可能な一方で、設定や操作に慣れが必要なツールと言えます。 もし操作の複雑さにハードルを感じる場合は、次のセクションで紹介する、より手軽に使える代替ツールがおすすめです。

Part 2:より簡単で実用的な画像から動画生成の代替ツール

Wanの画像から動画生成モデルは高い表現力を持つ一方で、モデル選択や設定、プロンプト調整など、ある程度の知識や慣れが必要です。 その点、Edimakor は、複雑な操作を省き、誰でも直感的に動画を生成できる点が大きな特長です。

Edimakorは、クリエイターはもちろん、教育関係者やマーケターなど、幅広いユーザーを想定したAI画像→動画生成ツールです。 専門的なAI知識や動画編集スキルがなくても、画像に自然な動きを加えた動画を短時間で作成できます。

技術的なパラメータ調整を行う必要はなく、用意されたテンプレートやガイドに沿って操作するだけ。 SNS投稿用のショート動画、プレゼン資料、プロモーション動画など、実用的なシーンで幅広く活用できます。

1 Edimakor AI画像から動画生成の主な特徴

以下は、Wanのような高度な生成モデルと比較した際に、Edimakorが「使いやすい代替手段」として評価される主なポイントです。

- Google Veo 3 / Veo 3.1 などの先進的なAI動画生成モデルを活用し、自然でリアルな映像表現を実現

- 1枚の写真、複数人の集合写真、参照画像からダイナミックな動画を生成可能

- ハグ・キス・ダンスなど、SNSで人気のAIモーション演出をワンクリックで適用

- 音楽のリズムに合わせて映像を自動調整し、没入感のある動画を作成

- スライドショー形式の動画を、自然なトランジションやアニメーション付きで生成

- 自動字幕、BGM追加、AI音声ナレーションなど、動画仕上げ機能も充実

2 Edimakorで画像から動画を作成する手順

まずは、PCにHitPaw Edimakorをダウンロード・インストールしてください。 インストール完了後、以下の手順に沿って操作するだけで、画像から簡単に動画を生成できます。

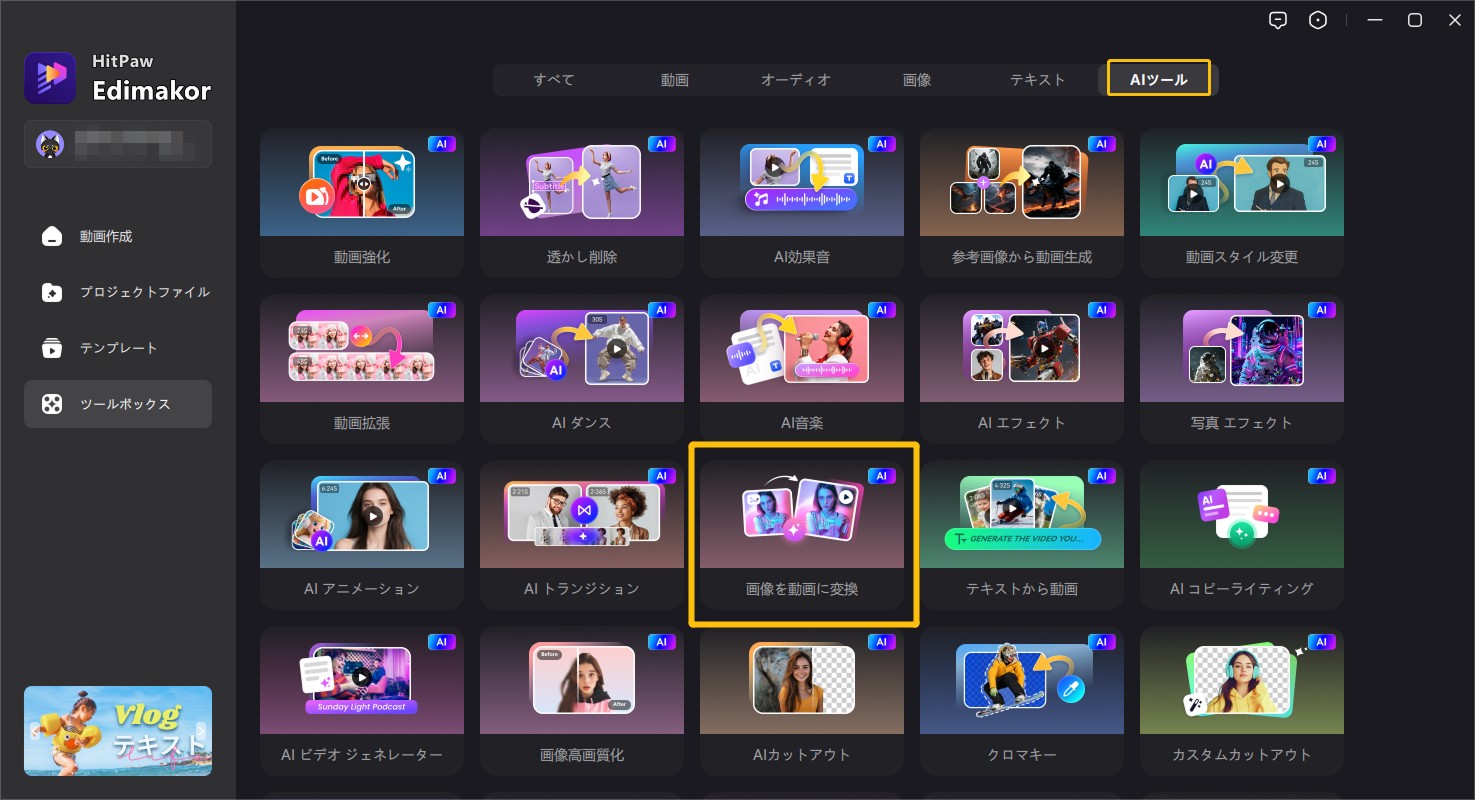

Step 1: Edimakorを起動し、左側メニューから 「ツールボックス」 をクリックします。 表示される機能一覧の中から 「画像から動画」 を選択すると、編集画面に移動します。

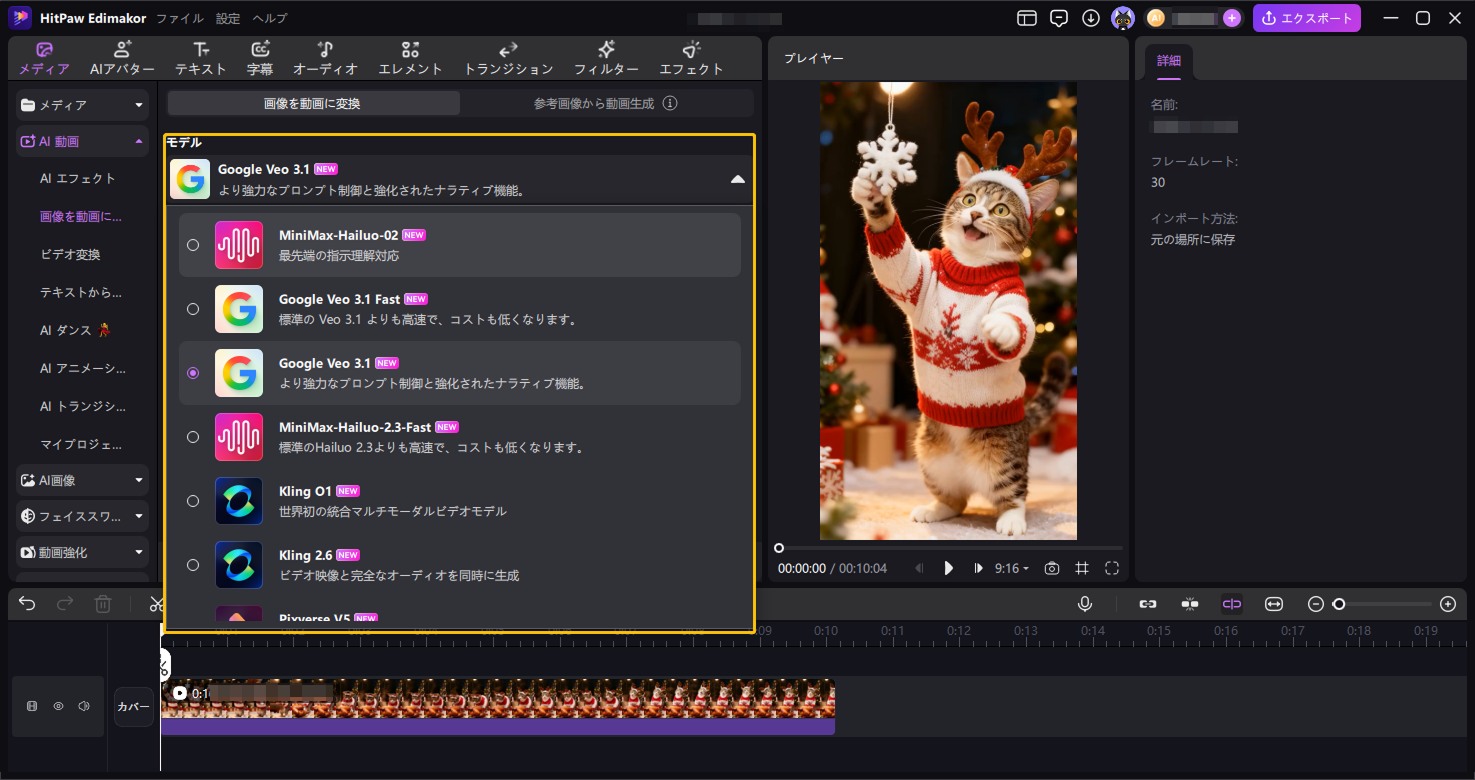

Step 2: 次に、動画化したい画像をアップロードします。 モデル選択画面では、よりリアルな表現が可能な Veo 3(またはVeo 3.1)モデルを選択できます。

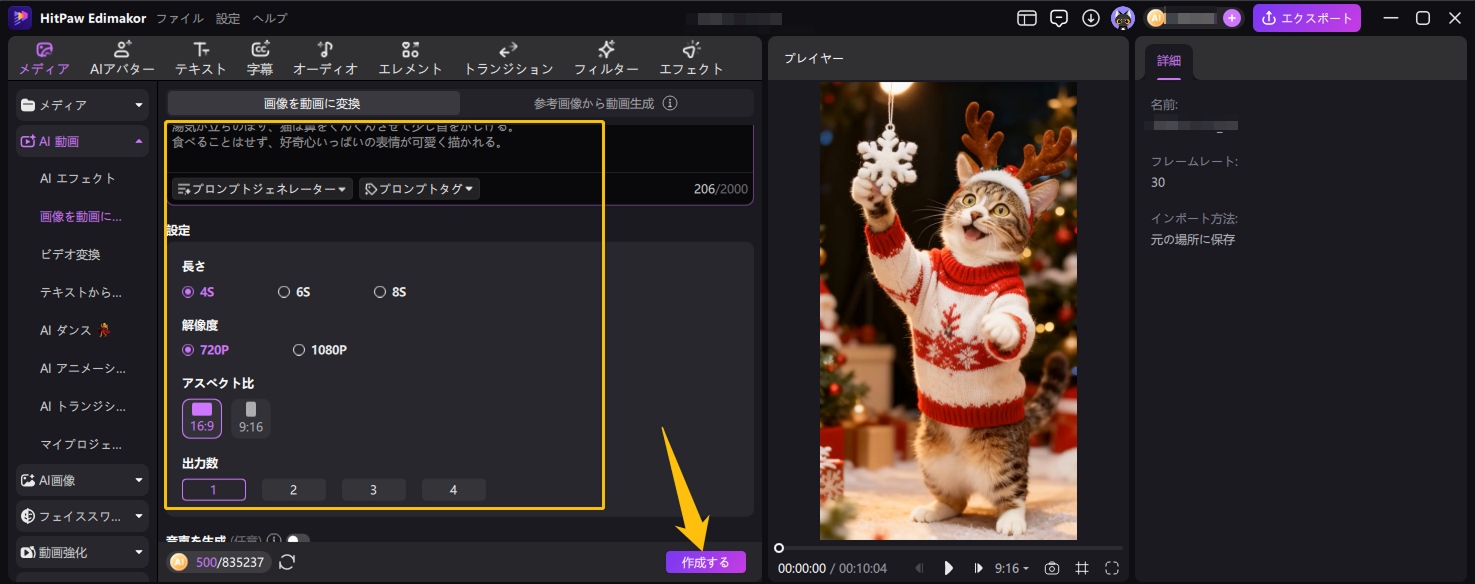

Step 3: 画像をアップロードしたら、生成したい動画のイメージに合わせてプロンプトを入力します。 さらに、動画の長さや解像度などの設定を調整し、 「作成する」 ボタンをクリックすると、画像から動画の生成が始まります。

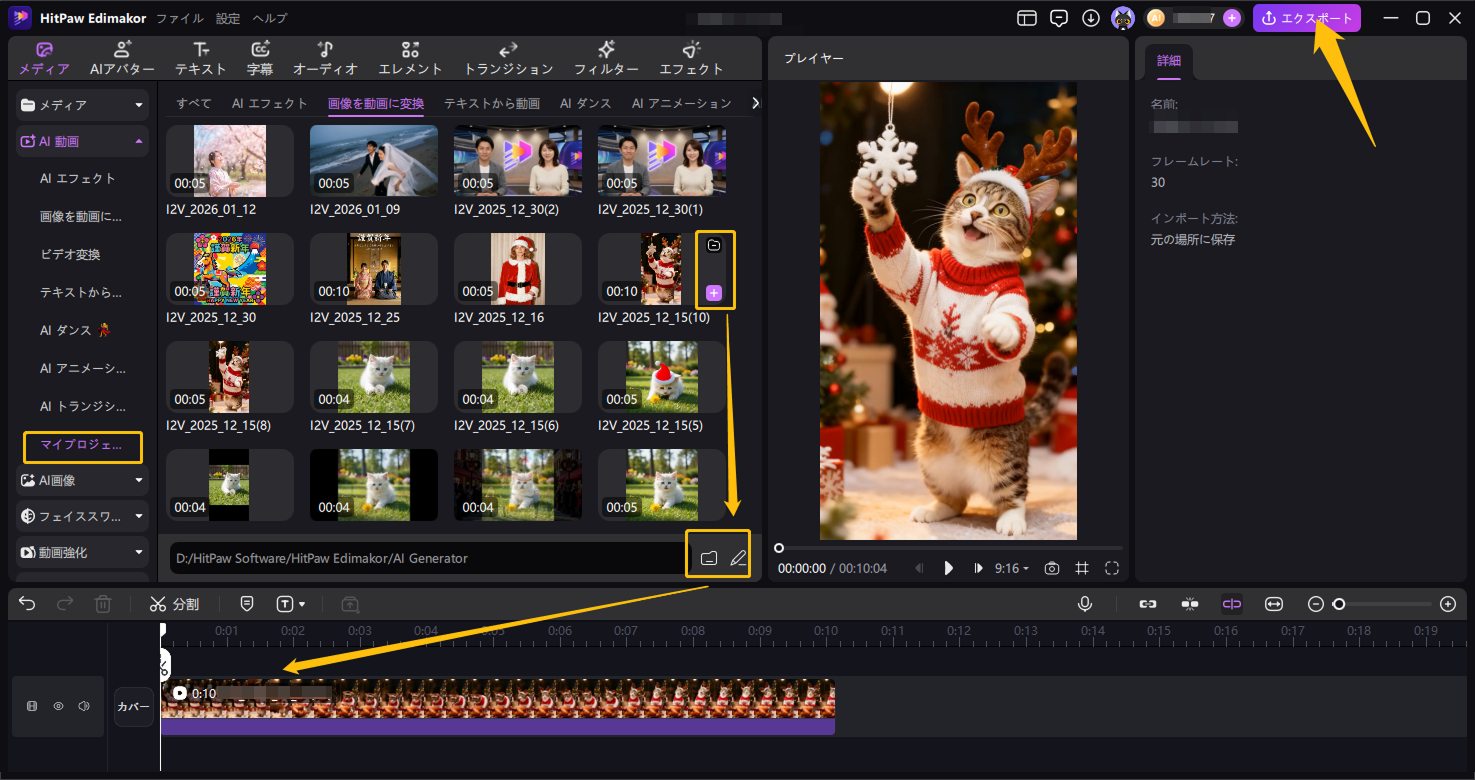

Step 4: 動画生成が完了したら、左側メニューの 「マイプロジェクト」 から生成した動画を選択し、プレビューで確認します。 問題がなければ、右上の 「エクスポート」 ボタンをクリックし、書き出し設定を選択して動画を保存してください。

3 WanとEdimakorの画像から動画生成を比較

Wanは高品質な動画生成が可能な一方で、環境構築や設定がやや複雑です。 そこでここでは、より手軽に使える Edimakor とWanを、機能・使いやすさ・対応環境の観点から比較してみましょう。

| 項目 | Wan(画像から動画生成) | HitPaw Edimakor |

|---|---|---|

| 主な用途 | 研究・検証向けのAI動画生成 | 一般ユーザー向け動画編集・AI動画生成 |

| 操作のしやすさ | やや複雑(設定・調整が必要) | 非常に簡単(初心者向けUI) |

| 画像から動画生成 | 対応 | 対応(Veo 3 / Veo 3.1モデル搭載) |

| モデル選択 | 複数モデル(用途別に選択) | 用途別に最適化されたAIモデル |

| 生成品質の安定性 | 設定次第で高品質だが差が出やすい | 安定した高品質な動画を生成 |

| 編集機能 | 基本的に生成のみ | 字幕・BGM・音声・エフェクト編集対応 |

| 日本語対応 | 一部対応 | 完全対応 |

| おすすめユーザー | 上級者・技術検証目的 | 初心者・クリエイター・マーケター |

Wan 画像から動画生成に関するよくある質問

A1: ローカル環境でWan 2.2を実行する場合、高性能なGPUが必要になります。 一般的には、VRAM容量の大きいNVIDIA製GPU(上位モデル)が推奨されます。 高性能なPCを用意できない場合は、クラウド環境を利用する方法もあります。

A2: はい、複数の画像を使用できます。開始フレームと終了フレームとして画像を指定することで、動きの流れがより自然な動画を生成することが可能です。

A3: 生成される動画は比較的短く、モデルによって異なりますが、一般的には数秒程度です。高解像度(1080p)での出力に対応したモデルもありますが、設定や環境によって生成品質や安定性に差が出る場合があります。

まとめ

Wanの画像から動画生成とEdimakorは、それぞれ異なる強みを持つツールです。 Wanはリアルな映像表現やオープンソースである点が評価されており、細かな制御や検証用途に向いています。 一方で、 Edimakor は操作が非常にシンプルで、専門的な知識がなくても、画像から高品質な動画をスムーズに作成できる点が大きな魅力です。 編集や書き出しまで一つのソフトで完結できるため、効率よく動画を制作したい方に適しています。 画像を動画に変換して、すぐにコンテンツ制作に活用したい方は、ぜひEdimakorを試してみてください。

コメントで参加しよう!

HitPawの記事にレビューを書いてみましょう!